- Inicio

- ⟩

- Tecnología

- ⟩

- ChatGPT. Alcances, limitaciones y dilemas de la inteligencia artificial

ChatGPT. Alcances, limitaciones y dilemas de la inteligencia artificial

Notas periodísticas, canciones e inclusive discursos políticos han sido escritos por chat GPT ¿Cuáles son los alcances de esta tecnología?

09-06-2023

Por José Luis Reyes, Ciencia UNAM-DGDC

“ChatGPT ¿podrías hacerme una reseña de una película?”, “¿Podrías escribir un ensayo de la revolución rusa?” “¿Qué celular recomiendas de menos de 5000 pesos mexicanos?” Desde su lanzamiento en noviembre de 2022 el ChatGPT-3 ha sido bombardeado con tantas peticiones como la imaginación del usuario lo permita.

El auge de esta tecnología es evidente, pero también lo son las inquietudes sobre sus alcances, limitaciones e incluso los dilemas éticos que pueden presentarse por su uso inadecuado.

¿Cómo funciona?

Cuando le pregunté “¿Cómo funcionas”? el ChatGPT respondió que es un modelo de lenguaje de inteligencia artificial y que su función es procesar texto, entender lo que se le está preguntando y proporcionar respuestas en lenguaje natural. Pero ¿qué es inteligencia artificial y qué tiene que ver con el lenguaje?

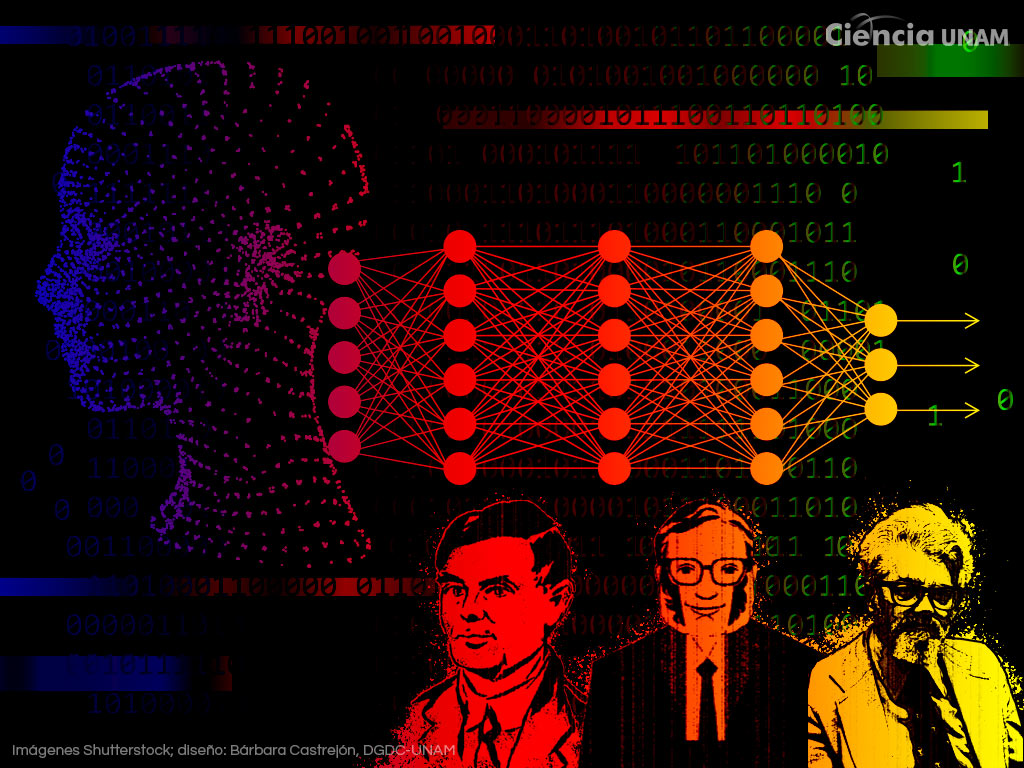

Para el doctor Luis Alberto Pineda Cortés, investigador en el Departamento de Ciencias de la Computación del Instituto de Investigaciones en Matemáticas Aplicadas y en Sistemas (IIMAS) de la UNAM, la inteligencia artificial es “una disciplina de investigación científica/tecnológica cuyo objetivo es modelar los procesos de la mente a través de máquinas computacionales”.

Lo que más ha llamado la atención de este asistente virtual es su capacidad de utilizar el lenguaje para responder lo que el usuario pide, siendo esto útil en muchos casos, desde la creación de contenido, la atención al cliente e inclusive la programación.

¿Cómo responde la mente digital?

A decir del doctor Pineda Cortés, esto puede remontarse a las cadenas de probabilidad del matemático ruso Andrei Markov, quien analizando la novela Eugenio Oneguin de Alexander Pushkin pudo formular una serie de herramientas que fueron utilizadas más tarde para los modelos de lenguaje.

Las cadenas de Markov se utilizan para predecir eventos futuros con base en acontecimientos pasados. Utilizando la novela de referencia, Markov clasificó la frecuencia de cada letra en la novela y formuló un sistema que estimaba la probabilidad de que una letra fuera vocal o consonante, de acuerdo a qué tipo de letras le precedieron.

Este asistente virtual funciona de una manera similar, al ser un modelo de lenguaje este analiza la probabilidad de que una palabra funcione en un texto de acuerdo a las palabras que le anteceden, analizando las que el usuario ingresa y depositando todas aquellas que concuerden con sus especificaciones.

Es por eso que ChatGPT suele ser medianamente preciso, ya que acota las posibilidades dependiendo de lo que nosotros pidamos, desde ensayos con cierta extensión, trabajos escolares, reseñas o simplemente preguntas como si se tratara de cualquier buscador de internet.

¿Para qué usarlo y para qué no?

Open AI, la organización sin fines de lucro responsable de este chat utiliza grandes bases de datos para proveer la información que necesita. Siendo esta sacada directamente de internet, es claro que los recursos que utiliza son amplios, aunque eso no significa que no tengan carencias.

La plataforma nos anuncia que su conocimiento está limitado a eventos anteriores al 2021, además de la posibilidad de que nos proporcione información incorrecta o parcial.

Aun tomando en cuenta lo anterior, algunos usuarios usan a chatGPT como un buscador de información, que la entrega de manera “digerida” y en el formato que al consumidor le convenga, a pesar de que muchos expertos advierten las desventajas de utilizarlo de dicha forma.

Para el investigador Pineda, usar a chatGPT como un motor de búsqueda no es hacer mal uso de esta tecnología, siempre y cuando se analice la información debidamente, se contraste y se contextualice aquello que la plataforma entrega.

Mucho se habla de que puede ser de gran utilidad para agilizar ciertas tareas “mecánicas” como la atención al cliente o la creación de códigos de programación, pero al ser el modelo de lenguaje más avanzado al que tenemos acceso también se puede usar para la creación de contenido, e inclusive la educación.

Al ser una tecnología relativamente nueva para el público general aún no queda claro el alcance que puede tener, y considerando que su programación le permite “aprender” puede que aún no veamos todo su potencial.

¿Deberíamos temerle?

Los alcances de la inteligencia artificial siempre han sido una de las mayores preocupaciones para la sociedad, desde su capacidad para suplir aquellos puestos que son ocupados por humanos, hasta, en términos más apocalípticos, la posibilidad que dejen de obedecer.

ChatGPT no ha sido la excepción, las escuelas temen que se plagien trabajos escolares, personalidades como Elon Musk o Steve Wozniak piden que se frenen las IA´s, además de que Italia frenó por un tiempo el acceso a este chat, pero ¿las preocupaciones están justificadas?

Según el Doctor Pineda Cortés no deberíamos de preocuparnos, ya que las tecnologías nuevas generan tendencias sociales con “una inercia propia” que no es posible controlar, “cuando el producto es útil socialmente la gente lo adopta porque resuelven una necesidad económica o afectiva genuina”.

Existe cierta preocupación porque las IA´s suplan a los humanos en el trabajo, para el especialista esto es algo que ya está pasando, pero solo en trabajos que pueden ser automatizados, mientras que aquellos que requieren más creatividad seguirán siendo humanos, por lo improbable que resulta el proceso creativo humano.

Con respecto a las preocupaciones de la academia, el investigador comenta que no es algo que no hayamos visto con wikipedia, y es deber de los profesores utilizar estrategias pedagógicas que contemplen la posibilidad del plagio, y que no sean resueltas con el famoso copia y pega, “educar más y mejor” concluye.

También advierte que hay que tener cuidado con que aquellos empresarios o líderes de opinión quieran “frenar” a las inteligencias artificiales, ya que muchas veces estas lo hacen para velar por sus propios intereses, tanto económicos como ideológicos.

Existe la posibilidad de que se haga un uso ilegítimo de estas herramientas, ya que Open AI asegura tener un control de donde obtiene su información pero nunca ha sido muy claro al respecto, por lo que el doctor Pineda comenta que la vigilancia individual, institucional o gubernamental será clave.

Lo anterior no es sorpresa para nadie, considerando que el cofundador de Open AI, Sam Altman, en una comparecencia con el Congreso de los Estados Unidos pidió que se regule y se impongan normas a la inteligencia artificial. “ Mi peor miedo es que esta tecnología salga mal. Y si sale mal, puede salir muy mal”.

Publicaciones relacionadas

¿Regular o No Regular la Inteligencia Artificial?

¿Quién regulará la Inteligencia Artificial?

Inteligencia Artificial aplicada a la solución de problemas nacionales